OpenAI的秘密:递归自我改进与AGI的临界点突破?

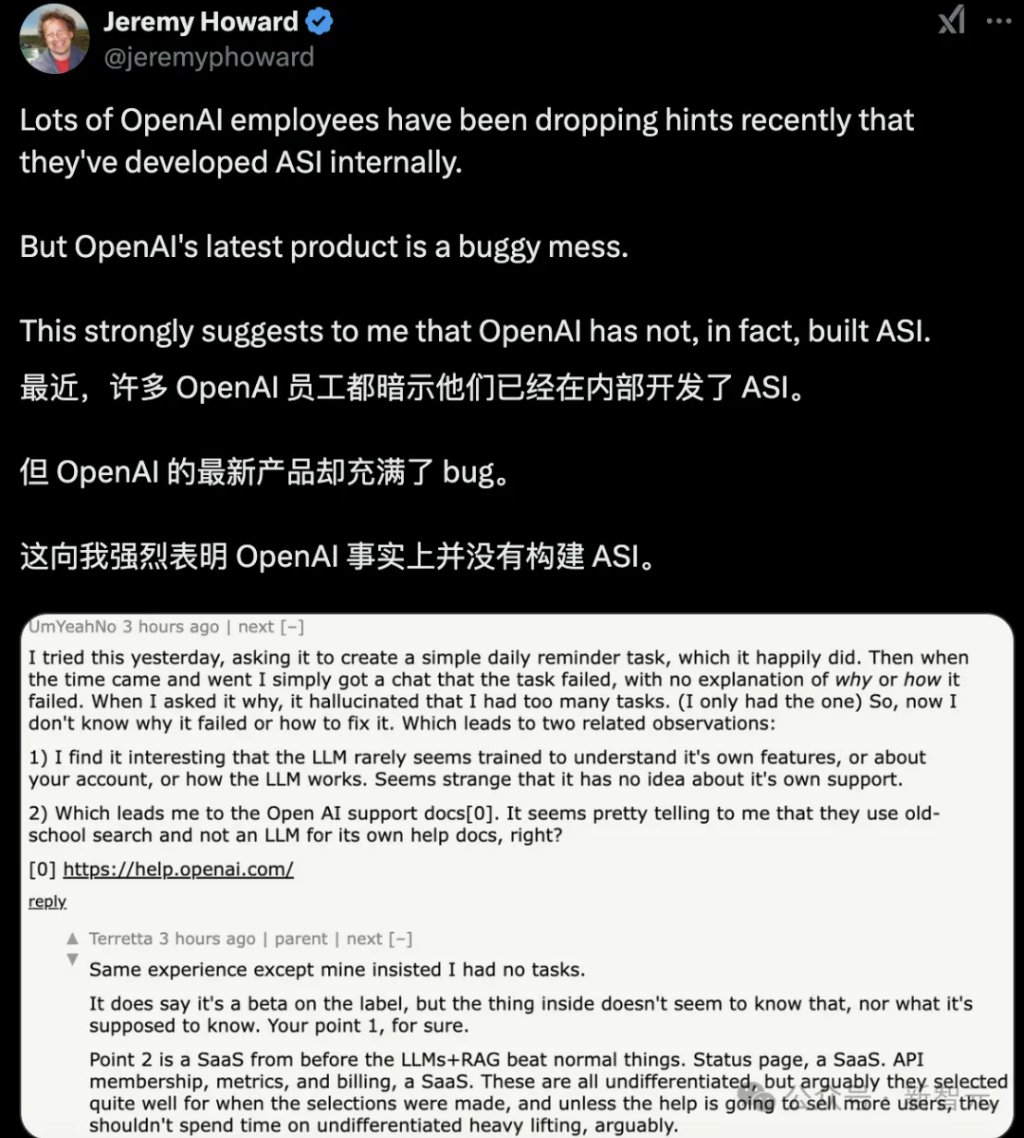

近期,围绕OpenAI的传闻甚嚣尘上,其内部员工暗示已开发出人工通用智能(AGI),甚至可能达到人工超级智能(ASI)的水平。这一说法源于对OpenAI内部模型o3、o4、o5的讨论,这些模型展现出惊人的能力,据称已经突破了‘递归自我改进’的临界点,能够自动化AI研发。

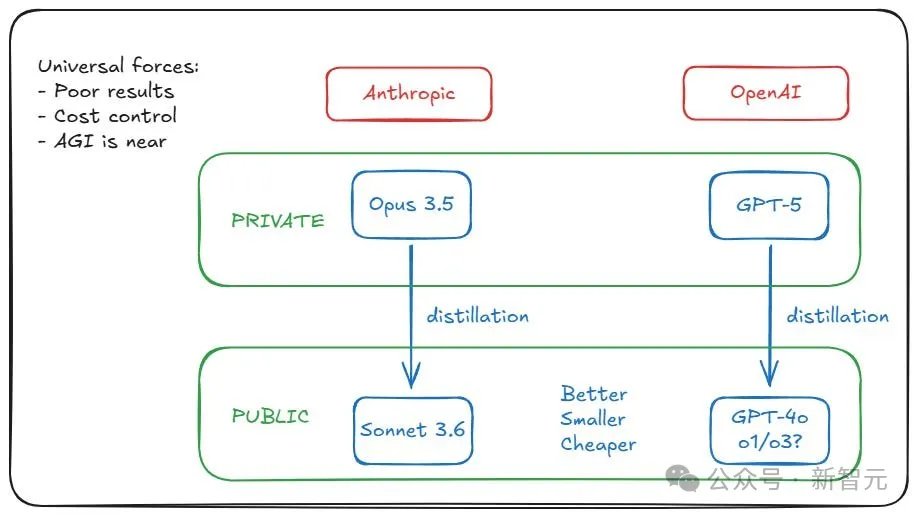

有消息称,OpenAI已研发出GPT-5,但由于其高昂的运营成本,选择将其“雪藏”,并利用其蒸馏出更具性价比的GPT-4o、o1、o3等模型。这一策略与Anthropic的做法类似,都优先投资于更高级模型的研发。

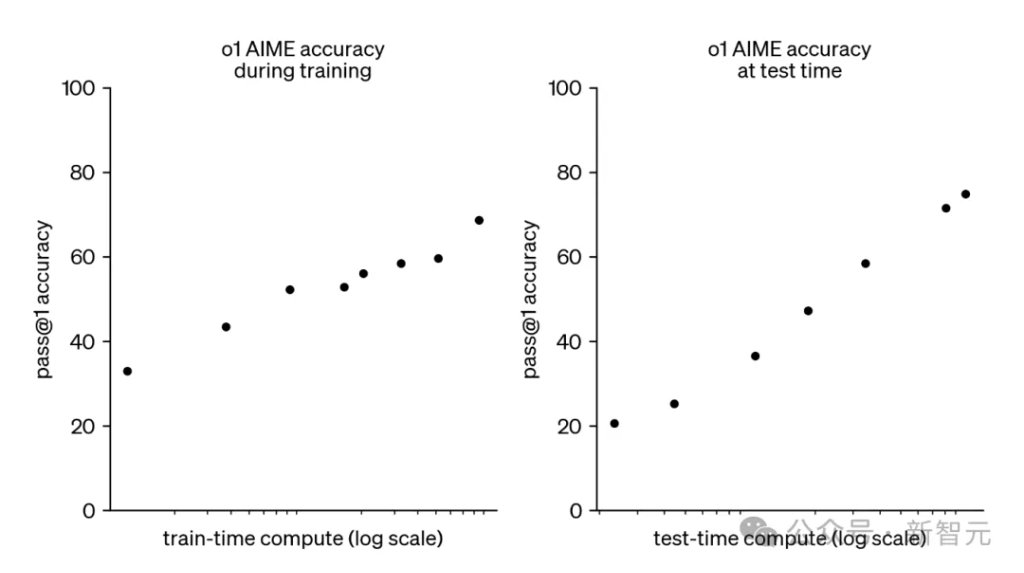

OpenAI的o系列模型,尤其o3,在多个基准测试中表现出色,例如在竞技编程、数学推理和视觉推理等方面均取得了突破性进展。其性能提升主要归功于更长的思维链和强化学习的改进。虽然目前运行o3成本高昂,但推理成本正快速下降,这将推动AI能力的进一步提升。

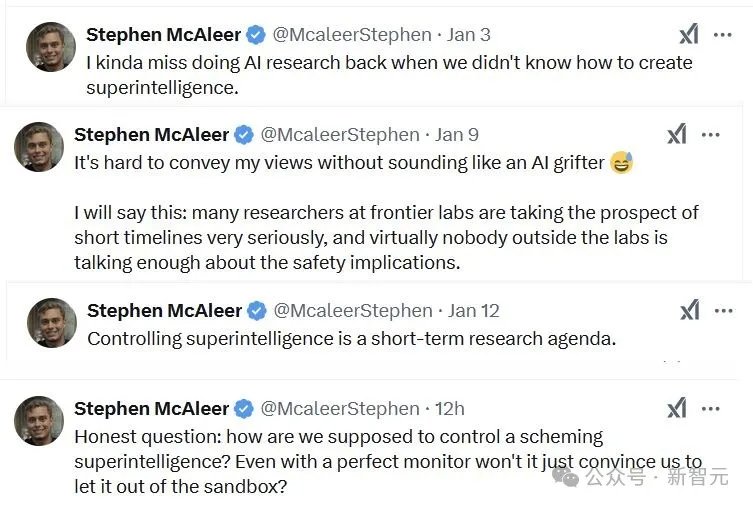

这一进展对AGI时间表的影响值得关注。一些预测平台将强AGI的实现时间提前了一年,但仍存在不确定性。推理扩展范式也对AI安全性带来影响,一方面降低了高速或集体超级智能的短期风险,另一方面也可能因更难解释模型而带来新的挑战。

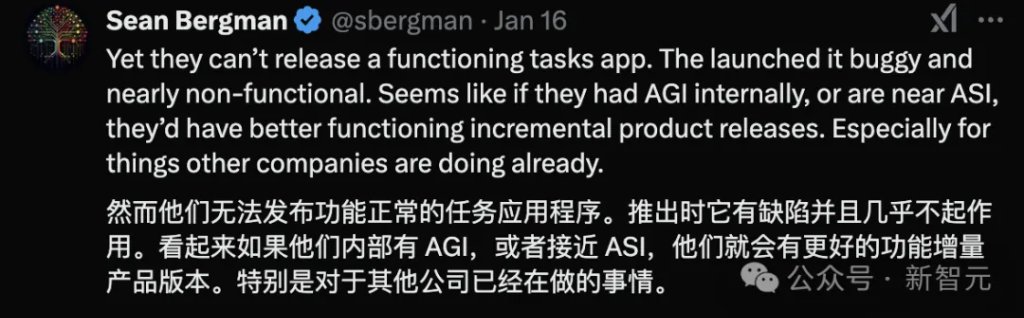

OpenAI内部员工的言论,以及CEO奥特曼前后矛盾的表述,引发了业界广泛关注。有人认为这是OpenAI的炒作手段,但也有人担忧,人类真的已站在ASI的边缘。

总而言之,OpenAI在AI研发领域似乎取得了重大突破,但其具体进展和未来走向仍存在不确定性。关于AGI和ASI的讨论,以及由此带来的安全和伦理问题,将持续成为业界关注的焦点。

本文 ethergome.com 原创,转载保留链接!网址:https://www.ethergome.com/post/1135.html

1.本站遵循行业规范,任何转载的稿件都会明确标注作者和来源;2.本站的原创文章,请转载时务必注明文章作者和来源,不尊重原创的行为我们将追究责任;3.作者投稿可能会经我们编辑修改或补充。